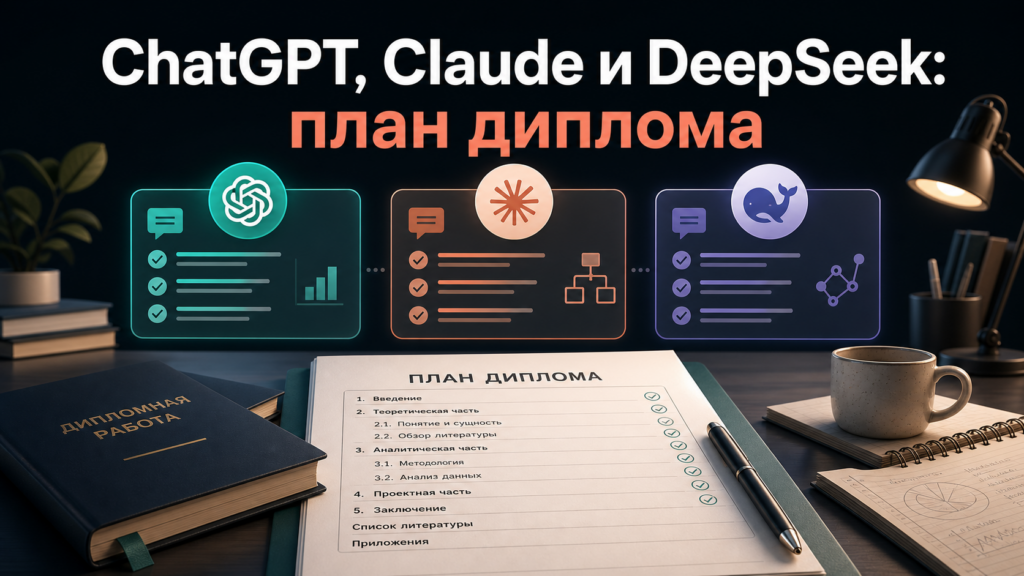

Когда студент открывает сразу три нейросети, кажется, что дальше вопрос только в удобстве интерфейса. На практике разница начинается уже на этапе плана диплома. Один сервис делает красивую, но пустую структуру. Второй помогает с логикой исследования. Третий ускоряет черновик, но проседает в проверяемости. Мы взяли одну и ту же задачу и посмотрели, что реально получится у ChatGPT, Claude и DeepSeek.

Чаще всего диплом начинает ломаться не на защите и даже не на этапе написания главы. Он ломается в тот момент, когда студент принимает первый сырой план за нормальную рабочую структуру.

Проблема в том, что нейросети очень хорошо умеют производить впечатление. План выглядит аккуратно. Формулировки звучат научно. Подразделы похожи на настоящую академическую логику. Но если копнуть глубже, оказывается, что тема раскрыта поверхностно, задачи не связаны с целью, а практическая глава живет своей жизнью.

Чтобы не спорить абстрактно, мы сравнили три популярные модели на одной и той же задаче. В качестве теста взяли условную тему диплома по менеджменту и цифровым продуктам:

`Как использование ИИ-инструментов влияет на учебную продуктивность студентов старших курсов`

Что мы просили у каждой модели:

— составить план диплома;

— предложить цель, задачи и гипотезу;

— разделить теорию и практику;

— показать, из чего будет состоять эмпирическая часть.

Сразу оговорюсь: ни одна нейросеть не выдает готовый диплом. Но каждая по-своему полезна, если понимать, где именно ее использовать.

СОДЕРЖАНИЕ

Что сделал ChatGPT?

ChatGPT лучше всех справился со скоростью первого захода. Он быстро дал понятную структуру, выделил введение, две главы, заключение и список литературы. Для студента, который в панике и не знает, с чего начать, это реально снижает тревогу.

Но у этого плюса есть минус. План получился слишком «гладким». Формулировки были универсальными:

— теоретические основы;

— анализ текущего состояния;

— разработка рекомендаций.

Такой каркас годится как черновик, но почти не чувствует тему. Если принести это научруку без доработки, первый вопрос будет простым: а где здесь именно влияние ИИ на продуктивность, где переменные, где логика исследования, где способ измерения эффекта.

Именно тут многие студенты совершают ошибку. Они видят нормальный русский текст и принимают его за содержательную научную работу. Хотя по сути это пока только шаблон.

Что сделал Claude?

Claude дал менее «продающий» ответ, но заметно лучше связал цель, задачи и структуру. В его версии план выглядел не таким глянцевым, зато сильнее чувствовалась логика исследования.

Особенно полезным оказалось то, что модель лучше удерживала причинно-следственную связку:

— что именно изучаем;

— по каким признакам будем оценивать;

— где теория переходит в эмпирику;

— какие данные понадобятся.

Если говорить честно, из трех вариантов именно Claude дал самый взрослый набросок для разговора с научруком. Не самый красивый, не самый «готовый на вид», но самый близкий к рабочему исследовательскому каркасу.

Его слабое место в другом. Иногда модель уходит в слишком общий академический стиль и не всегда предлагает достаточно конкретные измеримые индикаторы. То есть без человека сверху все равно остается риск получить умный, но расплывчатый план.

Что сделал DeepSeek?

DeepSeek оказался полезен там, где нужна практическая энергия. Он быстрее других начинает дробить задачу на подэлементы и часто предлагает более прикладной взгляд на будущую эмпирику.

Это удобно, когда студенту надо быстро накидать варианты:

— анкета;

— критерии сравнения;

— возможные показатели;

— структура опроса;

— черновик переменных.

Но именно у DeepSeek чаще встречалась неровность качества. В одном блоке логика была сильной, в другом начинались скачки по терминологии или слишком смелые обобщения. Это не катастрофа, но для диплома такая нестабильность опасна. Если не перечитывать внимательно, можно получить план, который выглядит динамично, но не держится как единая система.

Что оказалось самым важным?

Главный вывод вообще не про то, какая модель «лучше». Главный вывод в том, что студенту вредно искать одну волшебную кнопку.

На реальной задаче с планом диплома модели полезнее распределять по ролям:

— ChatGPT хорошо подходит для быстрого старта и снятия ступора;

— Claude лучше помогает выстроить исследовательскую логику;

— DeepSeek удобно использовать для расширения прикладных идей и вариантов эмпирики.

Если использовать их именно так, результат получается намного сильнее, чем при попытке выбрать одного абсолютного победителя.

Где начинаются ошибки?

После таких сравнений почти всегда всплывают одни и те же проблемы.

Первая ошибка в том, что студент просит «сделай план диплома», но не задает рамку. Без темы, предмета, объекта, метода и типа эмпирики любая модель будет выдавать усредненный результат.

Вторая ошибка в том, что никто не проверяет связку между целью, задачами и главами. А это первое, на чем обычно ловят сырой текст.

Третья ошибка еще неприятнее. После ответа нейросети студент не задает уточняющие вопросы. Хотя именно второй и третий круг диалога делают из черновика что-то похожее на реальную академическую конструкцию.

Возникли сложности?

Нужна помощь преподавателя?

Мы всегда рады Вам помочь!

Как использовать это без самообмана?

Если хочется получить от нейросети не красивую иллюзию, а полезный рабочий материал, я бы советовал такой порядок:

1. Сначала самому зафиксировать тему, объект, предмет и примерную практическую базу.

2. Потом попросить модель сделать не весь диплом, а только каркас плана.

3. После этого отдельно проверить цель, задачи и гипотезу.

4. Затем вручную посмотреть, как теория переходит в эмпирику.

5. И только потом расширять отдельные подразделы.

В этом режиме ИИ не подменяет мышление, а ускоряет черновую сборку.

У нас в disshelp.ru для таких случаев давно прижился очень простой протокол проверки плана. Мы отдельно смотрим, не просто красиво ли звучат пункты, а отвечают ли они на три скучных, но спасительных вопроса: что именно исследуется, чем это будет измеряться и как теория переходит в практику. Чем раньше студент прогоняет план через такой фильтр, тем меньше потом бессмысленных правок.

Итог

Если коротко, то победителя в формате «взял и понес научруку» здесь нет. Но полезный набор ролей есть.

ChatGPT хорош как быстрый старт.

Claude сильнее в логике исследования.

DeepSeek удобен для прикладных набросков и вариантов.

Самое опасное здесь не слабая модель, а ложное ощущение, что план уже готов только потому, что он хорошо звучит. В дипломе красивый каркас без внутренней связности очень быстро начинает трещать.

Трудности с учебой?

Требуется поддержка?

Помощь в написании студенческих и

аспирантских работ!