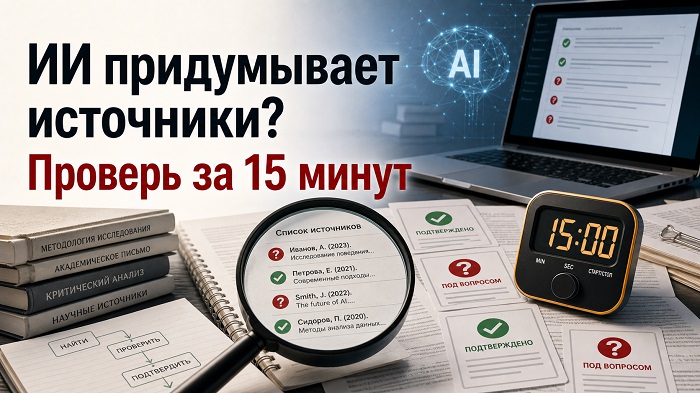

Вы попросили нейросеть собрать список литературы для курсовой, и она вернула аккуратный перечень с фамилиями, годами и даже номерами страниц. Всё выглядит правильно. Проблема в том, что часть этих источников не существует вообще. Ни журнала, ни автора, ни статьи. Мы проверили, как это работает на практике, и собрали протокол, который позволяет отловить фейковые ссылки за 15 минут.

Галлюцинации источников — это не баг, который скоро починят. Это фундаментальное свойство больших языковых моделей. Они не ищут информацию в базах данных. Они генерируют текст, который статистически похож на правильный ответ. А ссылка на научную статью — это просто ещё один фрагмент текста, который модель собирает из паттернов.

Именно поэтому выдуманные источники часто выглядят настолько убедительно. Фамилия автора реальная, но из другой области. Название журнала существует, но такой статьи в нём никогда не было. Год публикации правдоподобный. DOI — случайный набор цифр в правильном формате.

Студент, который берёт этот список и вставляет его в работу без проверки, рискует получить не просто замечание научрука, а серьёзные проблемы на защите. Потому что проверить ссылку может кто угодно за одну минуту.

СОДЕРЖАНИЕ

Что мы проверили?

Мы взяли типичный учебный запрос и попросили несколько моделей составить список из 10 источников по теме цифровизации образования. Тема специально была выбрана достаточно широкая, чтобы у моделей было пространство для генерации.

Результат получился показательным.

Из 30 источников, которые суммарно выдали три разные модели:

— 11 оказались полностью выдуманными — не существует ни статьи, ни автора в заявленном контексте;

— 7 содержали реальные фамилии, но с несуществующими работами;

— 4 были частично корректными — автор и журнал совпадали, но год или название были искажены;

— 8 оказались настоящими и проверяемыми.

То есть примерно две трети списка были непригодны для академической работы в том виде, в каком их выдала нейросеть.

Как выглядят типичные фейковые ссылки?

Есть несколько паттернов, которые повторяются раз за разом.

Первый паттерн — знакомая фамилия плюс несуществующая работа. Модель берёт реального известного автора и приписывает ему статью, которую он никогда не писал. Это самый опасный тип, потому что фамилия на слуху и студент не сомневается.

Второй паттерн — правильный журнал, но выдуманная статья. Журнал реальный, ISSN совпадает, но конкретной публикации в его архиве нет. Чтобы поймать это, нужно зайти на сайт журнала и проверить содержание конкретного выпуска.

Третий паттерн — полная компиляция из разных источников. Модель берёт часть названия одной реальной статьи, фамилию из другой и год из третьей. Получается гибрид, который не существует, но звучит настолько естественно, что без целенаправленной проверки его не заметить.

Четвёртый паттерн — корректный DOI с неверным содержимым. Модель генерирует DOI в правильном формате, и иногда этот DOI даже ведёт куда-то, но совершенно не на ту статью, которая указана в ссылке.

Протокол проверки за 15 минут

Мы используем простой пятишаговый протокол. Он не требует платных инструментов и занимает около 15 минут на список из 10 источников.

Шаг 1. Берите каждый источник отдельно и вводите точное название статьи в Google Scholar. Если статья реальная, она найдётся в первых результатах. Если Google Scholar её не знает, это первый тревожный сигнал.

Шаг 2. Проверьте автора через его реальный профиль. ORCID, Google Scholar Profile, ResearchGate, eLibrary. Если автор существует, но конкретной работы в его списке публикаций нет, источник скорее всего выдуман.

Шаг 3. Если указан DOI, вставьте его в doi.org. Работающий DOI моментально перенаправит на страницу статьи. Если DOI не резолвится или ведёт на другую работу, ссылка фальшивая.

Шаг 4. Для русскоязычных источников проверяйте через eLibrary.ru и CyberLeninka. Модели особенно часто галлюцинируют именно русскоязычные работы, потому что в их обучающих данных русскоязычная академическая база представлена слабее.

Шаг 5. Если после всех проверок остались сомнения, ищите журнал отдельно. Зайдите на сайт издания, откройте архив за указанный год и выпуск. Если такого выпуска нет или в нём нет нужной статьи, источник не прошёл верификацию.

Весь протокол по десяти источникам занимает 12-18 минут. Это быстрее, чем потом переписывать литературный обзор после замечаний.

Почему модели продолжают это делать?

Потому что генерация текста и поиск информации — это два разных процесса. Языковые модели оптимизированы на первое. Они создают текст, который выглядит правильным, потому что обучались на миллиардах примеров правильно выглядящих текстов.

Когда модель пишет ссылку на статью, она не проверяет, существует ли эта статья. Она собирает правдоподобную комбинацию из фамилии, названия, года, журнала и DOI. И часто эта комбинация выглядит безупречно.

Новые модели стали галлюцинировать реже, но ни одна из них не решила проблему полностью. Даже при использовании RAG и подключении к базам данных остаётся процент ошибок. А в академической работе даже один фейковый источник может стоить допуска к защите.

Чего делать точно не стоит?

Не стоит просить ту же модель проверить свои собственные ссылки. Она с высокой вероятностью подтвердит, что источник реальный, потому что у неё нет механизма отличить сгенерированный текст от настоящего.

Не стоит полагаться на формат. Аккуратно оформленная ссылка по ГОСТу не означает, что источник существует. Модель прекрасно умеет форматировать, и именно это создаёт ложное чувство надёжности.

Не стоит игнорировать русскоязычные источники при проверке. Студенты часто проверяют англоязычные ссылки через Google Scholar и пропускают русские, которые как раз чаще всего оказываются выдуманными.

Возникли сложности?

Нужна помощь преподавателя?

Мы всегда рады Вам помочь!

Что реально помогает?

Кроме ручного протокола есть несколько подходов, которые снижают риск.

Первый — давать модели конкретный список баз данных для поиска. Не просто \»найди источники\», а \»ищи только в Google Scholar, eLibrary, CyberLeninka за 2020-2026 годы\». Это не гарантия, но сужает пространство для галлюцинаций.

Второй — просить модель для каждого источника сразу давать прямую ссылку на полнотекстовый вариант. Если она не может дать ссылку, это сигнал.

Третий — разделять задачи. Одна сессия для поиска реальных источников. Другая для анализа их содержания. Третья для структурирования обзора. Когда модель делает всё одновременно, качество каждого этапа падает.

У нас в disshelp.ru этот протокол проверки стал стандартной частью работы с любым литературным обзором. Неважно, собирал его студент вручную, через нейросеть или комбинированным способом. Проверка идёт одинаково, потому что ошибки в источниках встречаются в любом варианте, просто с ИИ их статистически больше.

Итог

Нейросети не врут специально. Они делают то, для чего обучены — генерируют правдоподобный текст. Просто для академических источников правдоподобность без верифицируемости не стоит ничего.

Проверка занимает 15 минут и спасает от проблем, которые потом могут стоить недель. Протокол простой, бесплатный и не требует специальных знаний. Единственное условие — не пропускать его, даже если список выглядит идеально.

Трудности с учебой?

Требуется поддержка?

Помощь в написании студенческих и

аспирантских работ!